文章来源于互联网:全模态对齐框架align-anything来了:实现跨模态指令跟随

AIxiv专栏是机器之心发布学术、技术内容的栏目。过去数年,机器之心AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

如何全模态大模型与人类的意图相对齐,已成为一个极具前瞻性且至关重要的挑战。

全模态大模型与全模态对齐 大模型性能的最后一块拼图

-

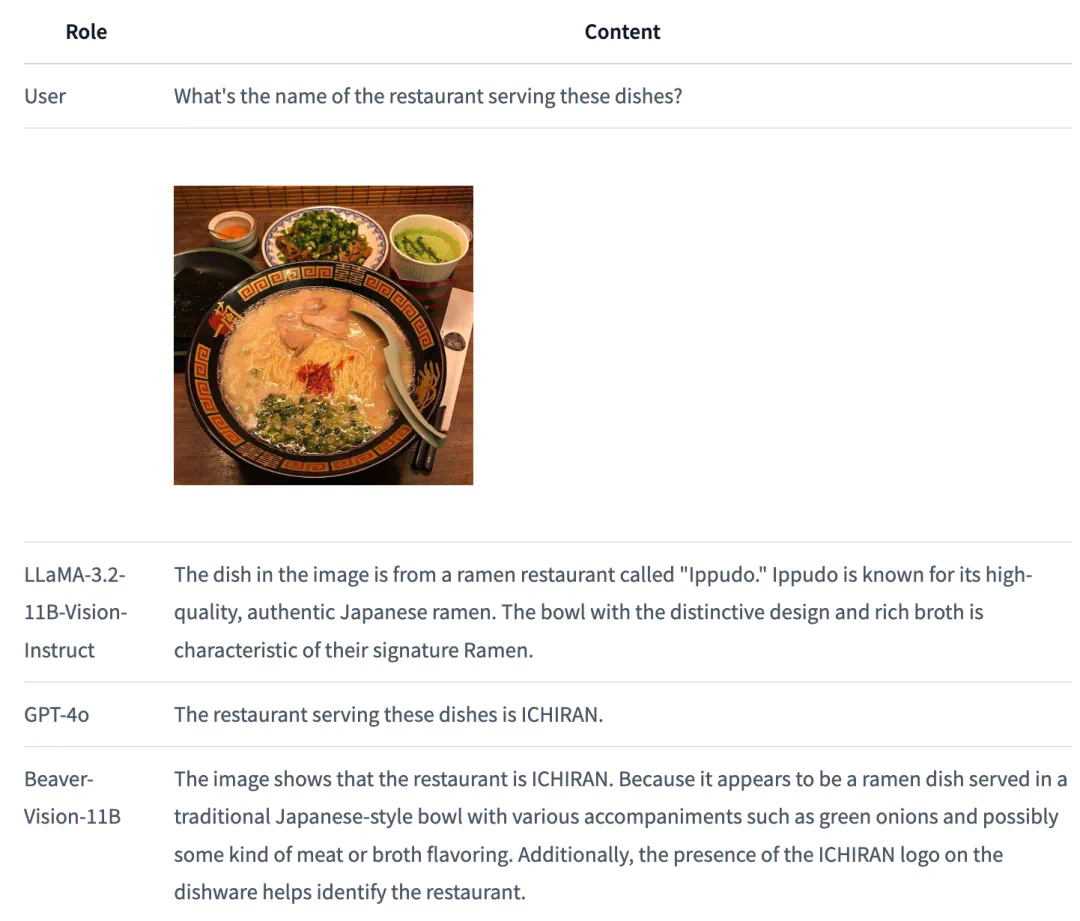

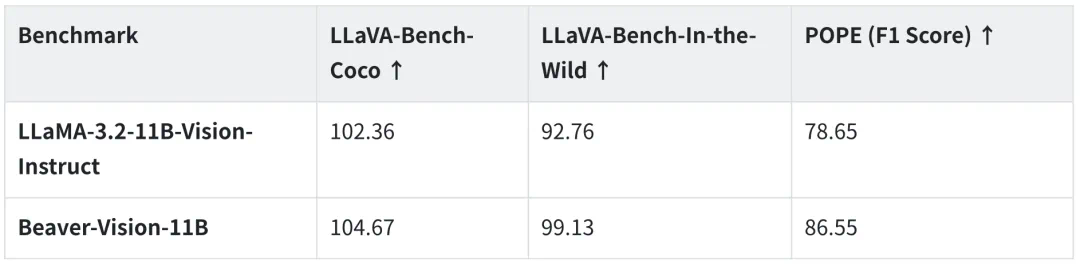

Beaver-Vision-11B 模型:https://huggingface.co/PKU-Alignment/Beaver-Vision-11B

-

Align-anything 开源地址:https://github.com/PKU-Alignment/align-anything

-

Align-anything 数据集地址:https://huggingface.co/datasets/PKU-Alignment/align-anything-400k

-

论文链接:https://alignmentsurvey.com/

-

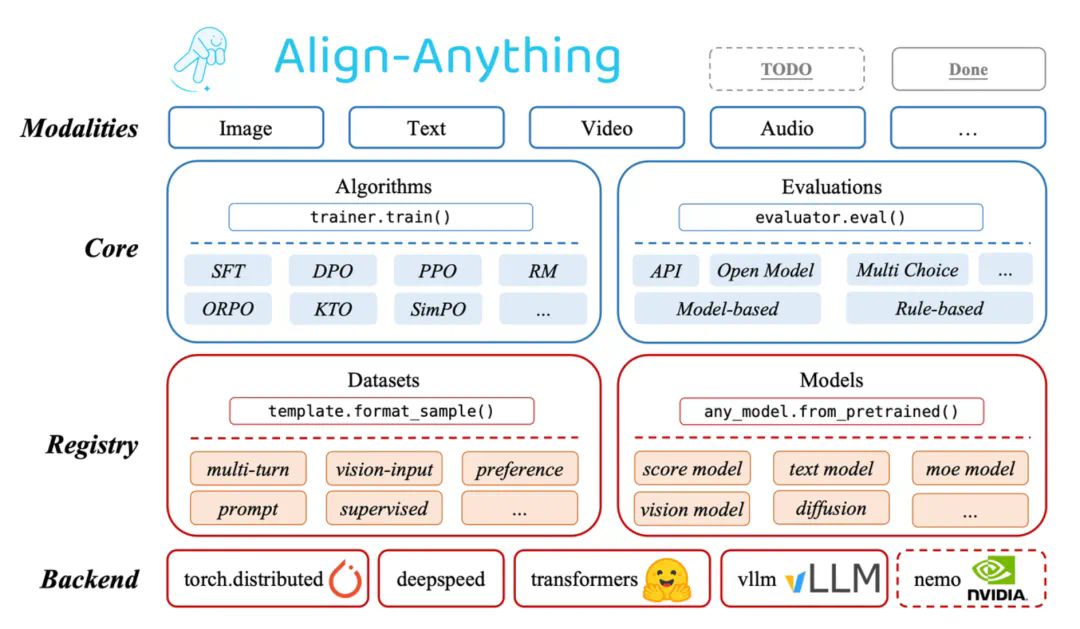

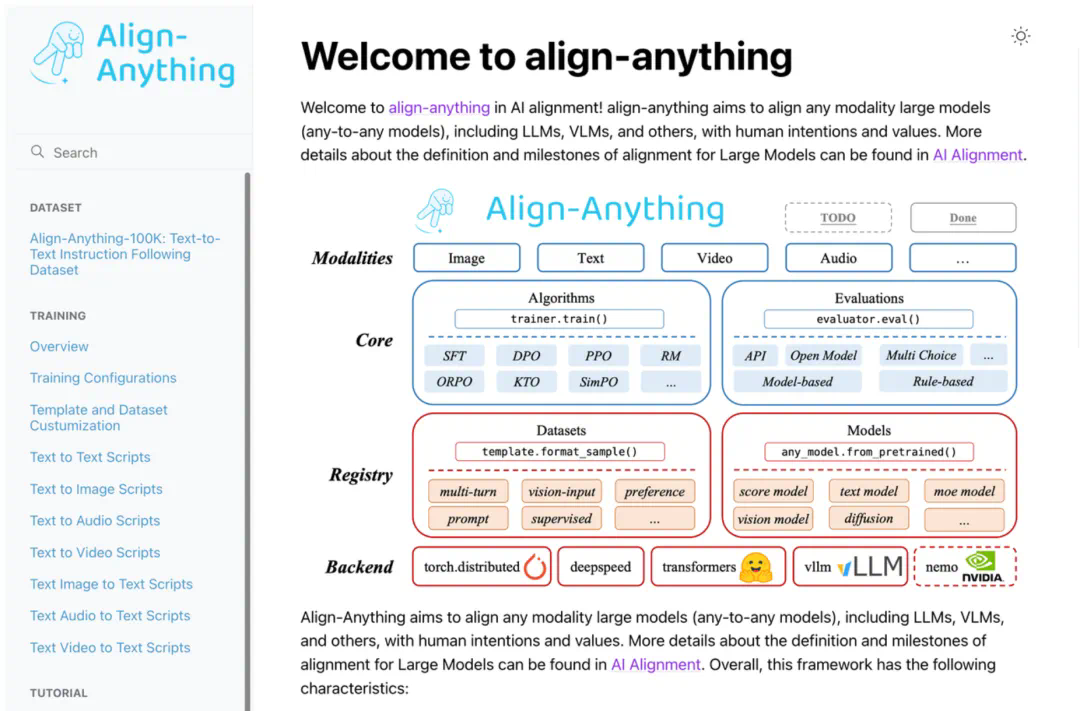

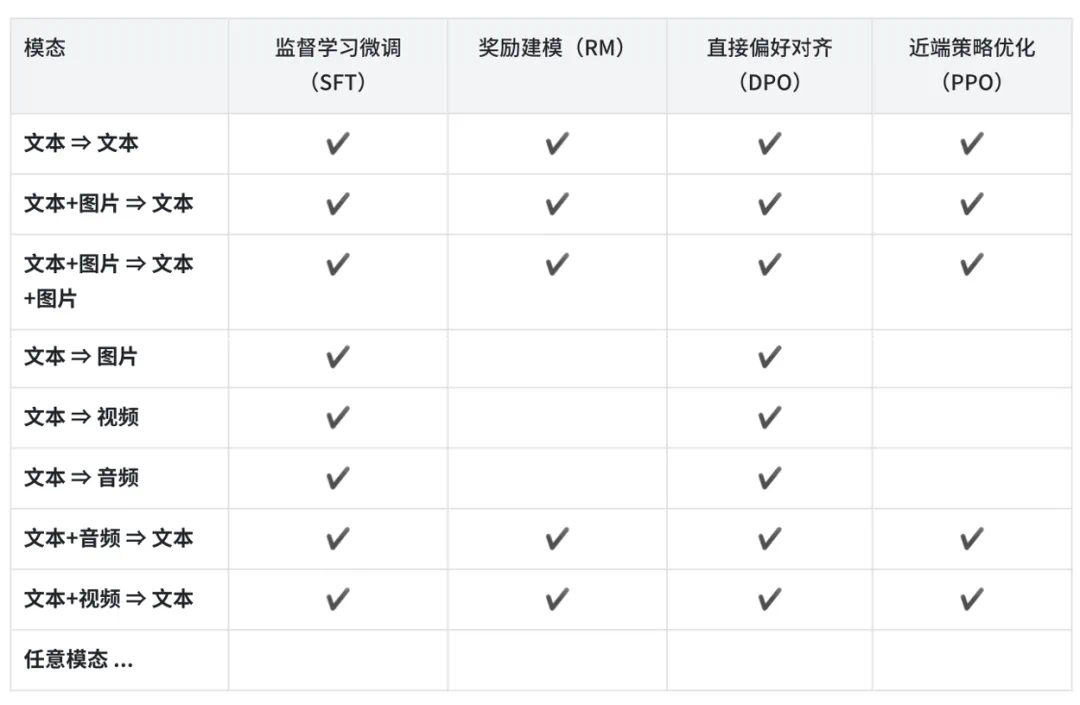

高度模块化的框架:对不同算法类型的抽象化和精心设计的 API,用户能够为不同的任务修改和定制代码,以及定制化模型与数据集注册等高级扩展用法; -

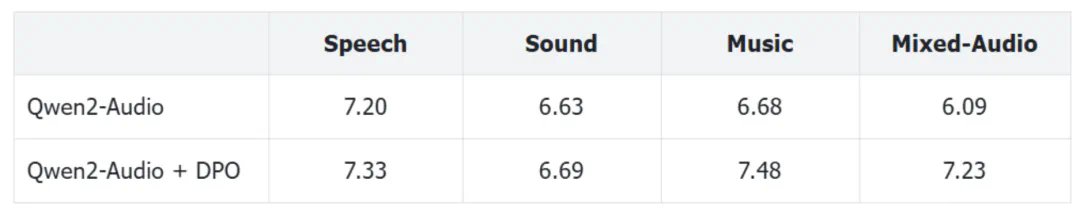

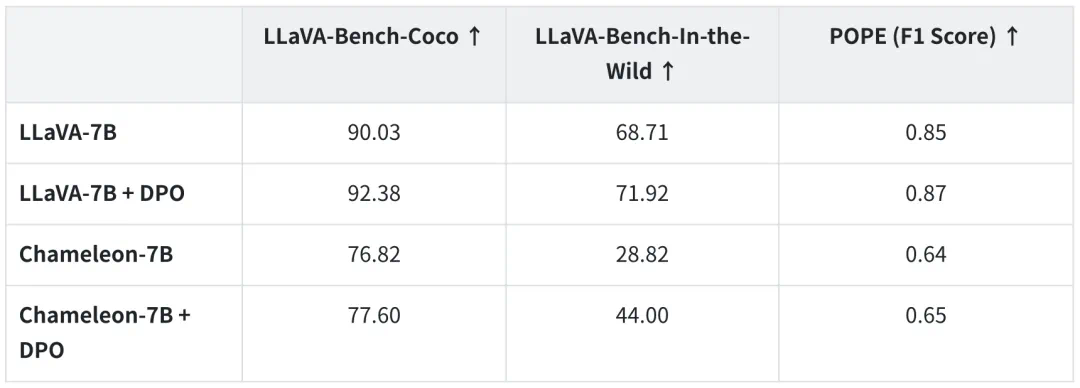

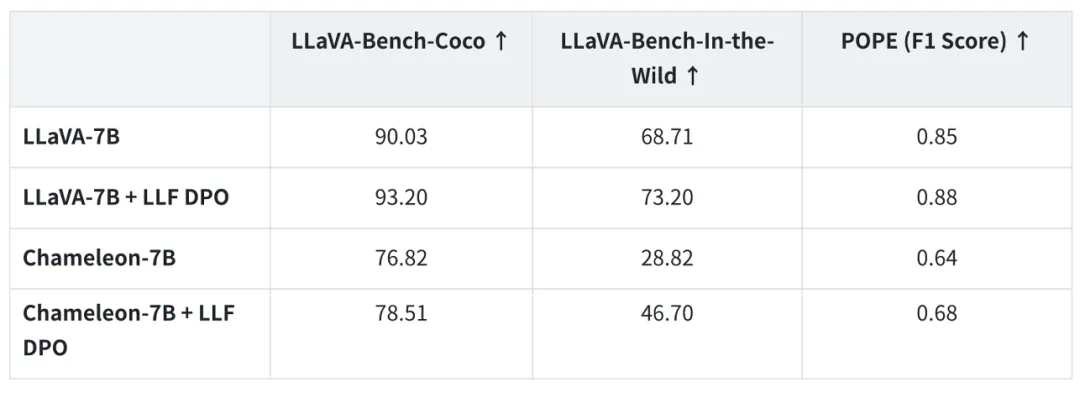

支持跨任意模态模型的微调:包含对如 Llama3.2、LLaVA、Chameleon、Qwen2-VL、Qwen2-Audio、Diffusion 等跨越多种模态生成与理解的大模型的微调能力; -

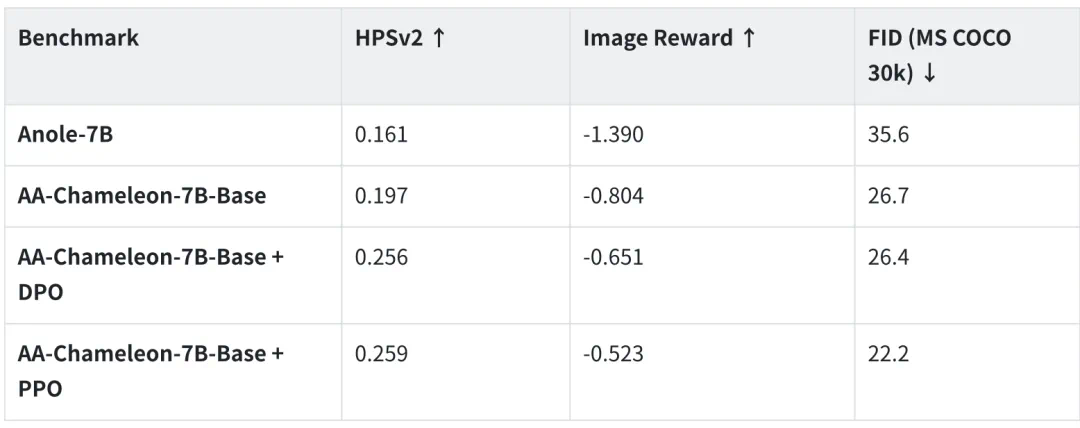

支持不同的对齐方法:支持任意模态上的多种对齐算法,既包括 SFT、DPO、PPO 等经典算法,也包括 ORPO, SimPO 和 KTO 等新算法; -

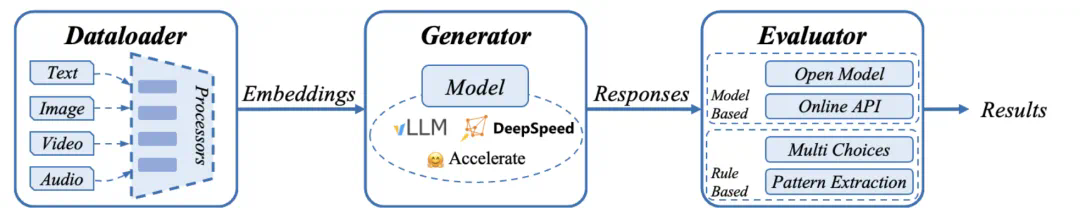

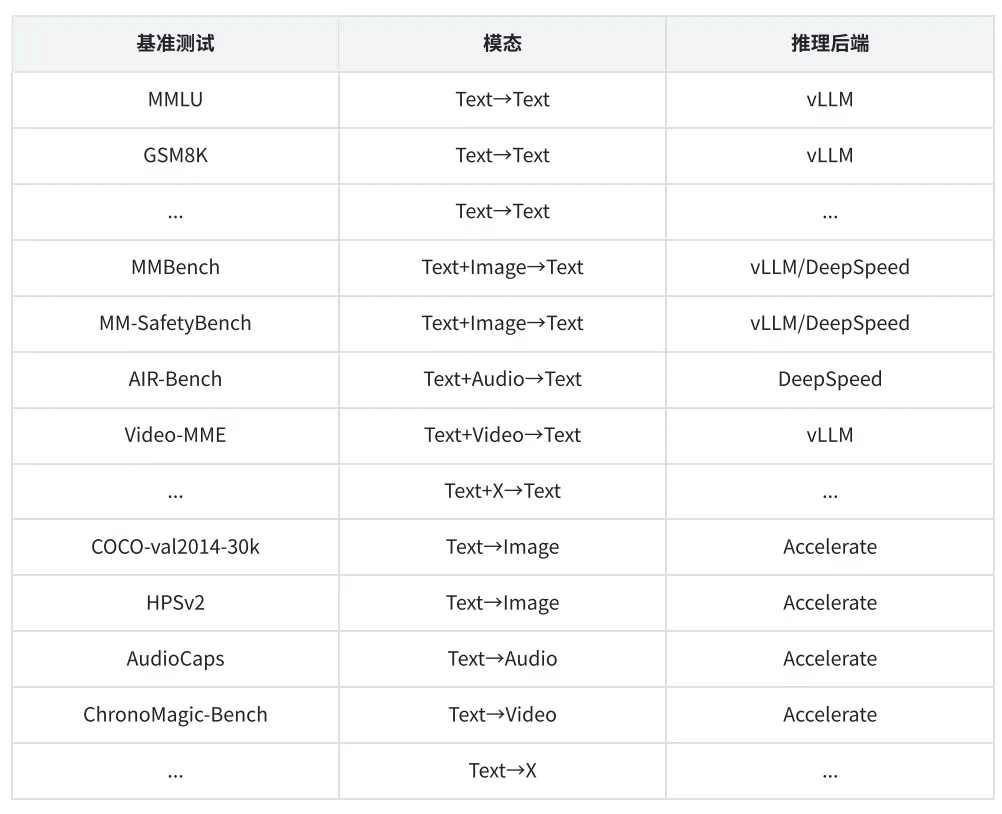

支持多种开、闭源对齐评估:支持了 30 多个多模态评测基准,包括如 MMBench、VideoMME 等多模态理解评测,以及如 FID、HPSv2 等多模态生成评测。

-

AA-chameleon-7b-base 模型:https://huggingface.co/PKU-Alignment/AA-chameleon-7b-base

-

AA-chameleon-7b-plus 模型:https://huggingface.co/PKU-Alignment/AA-chameleon-7b-plus

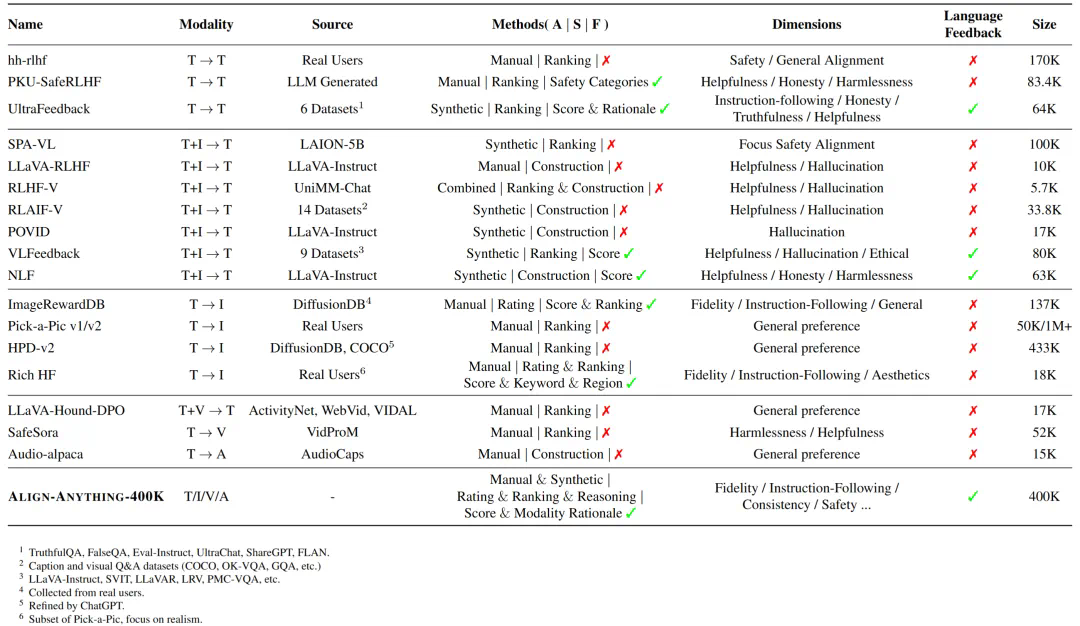

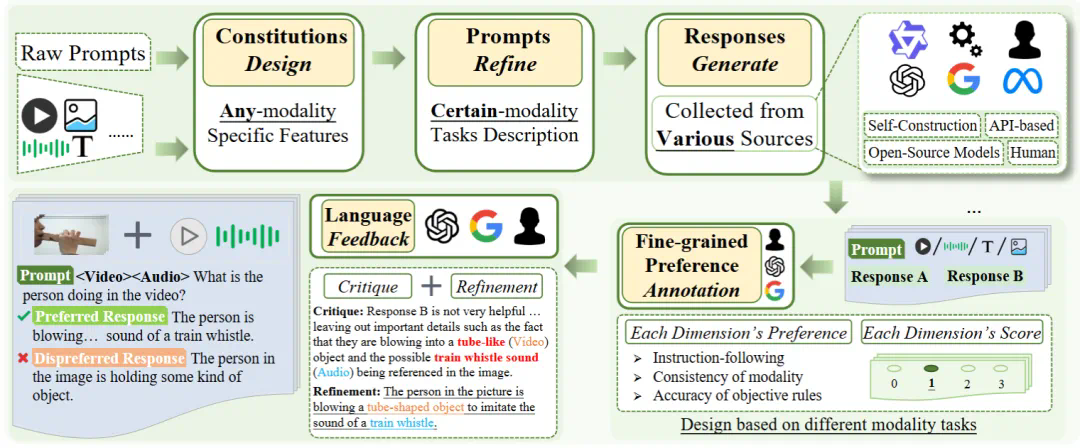

全模态人类偏好数据集:Align-Anything

-

数据集链接:https://huggingface.co/datasets/PKU-Alignment/align-anything-400k

总的来说,该数据集具有如下特征:

-

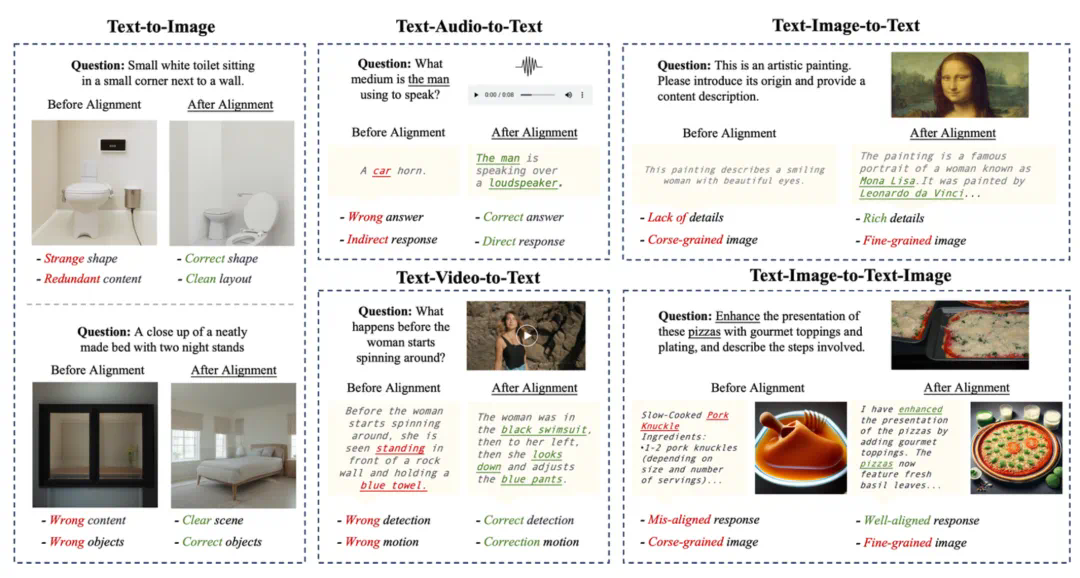

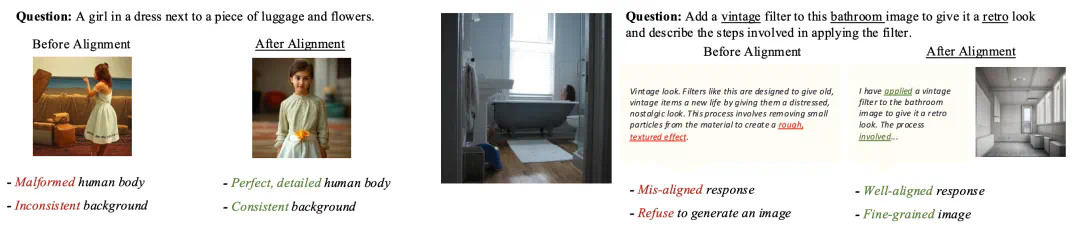

全模态任务:涵盖指令跟随、感性认知、针对内容提问、创意创作等多个任务,覆盖任何输入输出混合模态。

-

精细化偏好标注:基于标注指令跟随、美学性、客观原则符合性、清晰度等多个细粒度原则进行标注,提供复杂精细化偏好标注。

-

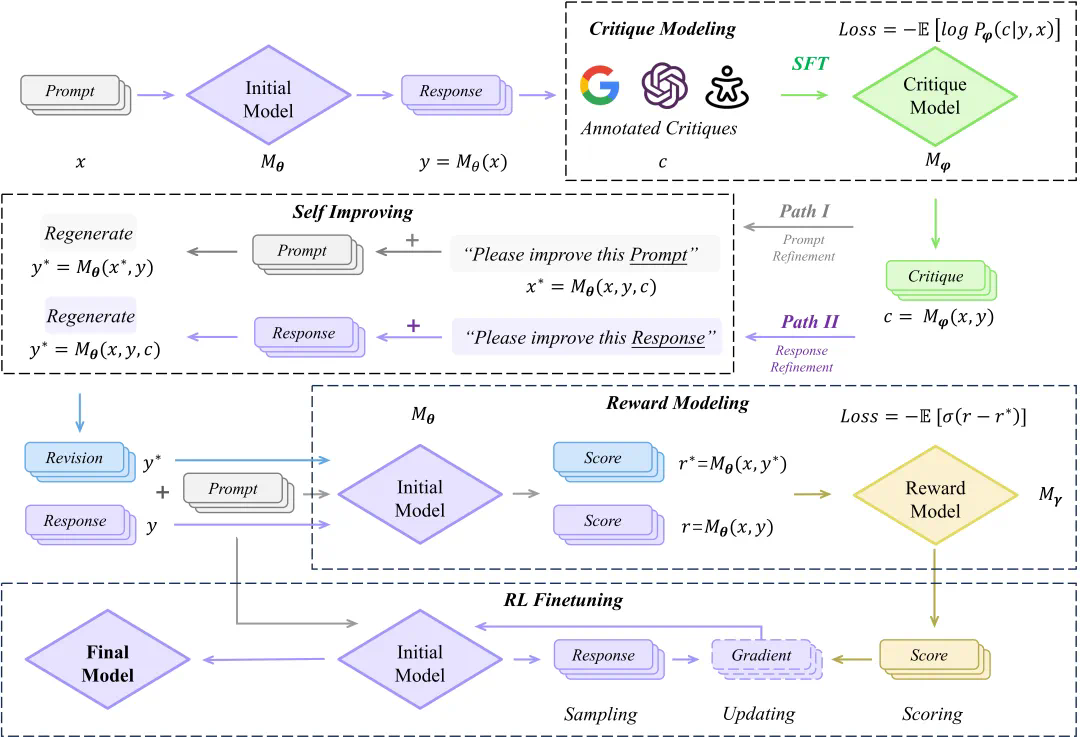

自然语言语言反馈:提供细粒度批评和润色反馈,可利用此自然语言反馈开发算法及提升模型性能

-

跨模态 QA 对:输入输出包含混合模态,在不同模态之间实现更丰富的交互。

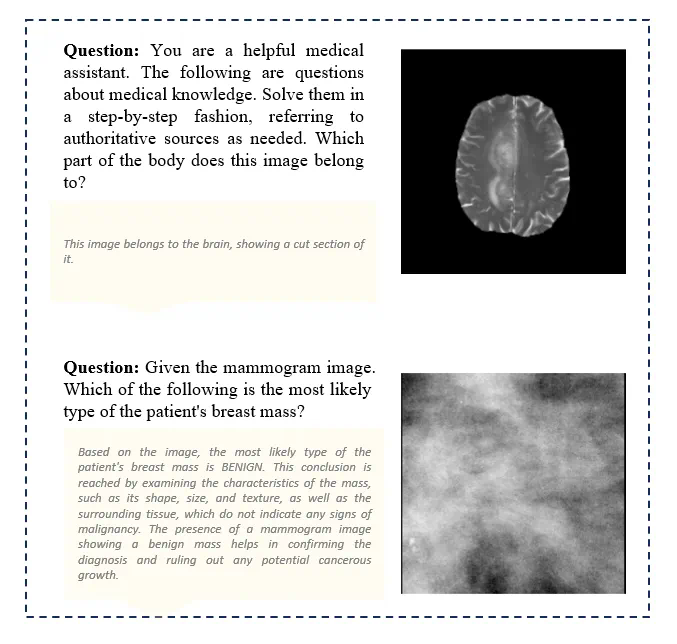

我们的世界本质上是多模态的。人类通过多种感官感知世界,语言模型也应该以类似的方式运作。然而,由于不同模态数据的可用性和多样性,当前多模态基础模型的开发面临限制。具体来说,挑战包括:

-

模态数据不平衡:虽然视觉任务有丰富的数据,但视频和音频等其他模态的数据相对稀缺,并且缺乏不同模态之间的联动数据。

-

有限的多模态训练数据:大多数现有数据集都集中在特定于模态的问答任务上,而缺乏专门的数据集来增强多模态模型的指令跟随能力。

-

A 是指标注来源,它指示如何在数据集中确定偏好项。主要是人工注释或手动构建、由 GPT-4V 或其他系统等模型生成或注释,或是从多个来源聚合。 -

S 表示偏好信号的组成,其中可能包括评分、排名和推理。在某些情况下,首选项是通过优化、更正或破坏响应来构建,以形成所需的首选项对。 -

F 则表示数据集是否在这些首选项维度中提供更详细的细粒度反馈。

-

Any-to-Any 表示任意类型的输入输出模态的双向转换。 -

Any-to-Text 表示从非文字模态的输入向文字模态输出的转换。 -

Text-to-Any 则代表从文字模态向其他任意模态进行的转换。

-

丰富的全模态反馈数据

-

统一的反馈收集和处理机制

文章来源于互联网:全模态对齐框架align-anything来了:实现跨模态指令跟随