文章来源于互联网:NeurIPS 2024 | 如何防御对抗性提示攻击?AdvUnlearn让图片生成风险骤降

AIxiv专栏是机器之心发布学术、技术内容的栏目。过去数年,机器之心AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

本文第一作者为密歇根州立大学计算机系博士生张益萌,为 OPTML 实验室成员,指导教师为刘思佳助理教授。OPtimization and Trustworthy Machine Learning (OPTML) 实验室的研究兴趣涵盖机器学习 / 深度学习、优化、计算机视觉、安全、信号处理和数据科学领域,重点是开发学习算法和理论,以及鲁棒且可解释的人工智能。

扩散模型(Diffusion Models, DMs)已经成为文本到图像生成领域的核心技术之一。凭借其卓越的性能,这些模型可以生成高质量的图像,广泛应用于各类创作场景,如艺术设计、广告生成等。然而,随着扩散模型的日益普及,其带来的安全问题也逐渐显现。模型在处理开放式互联网数据时,可能会在生成过程中输出有害的、不适当的内容,例如裸露、暴力、侵犯版权的图像等,这为其实际应用带来了道德和法律上的挑战。

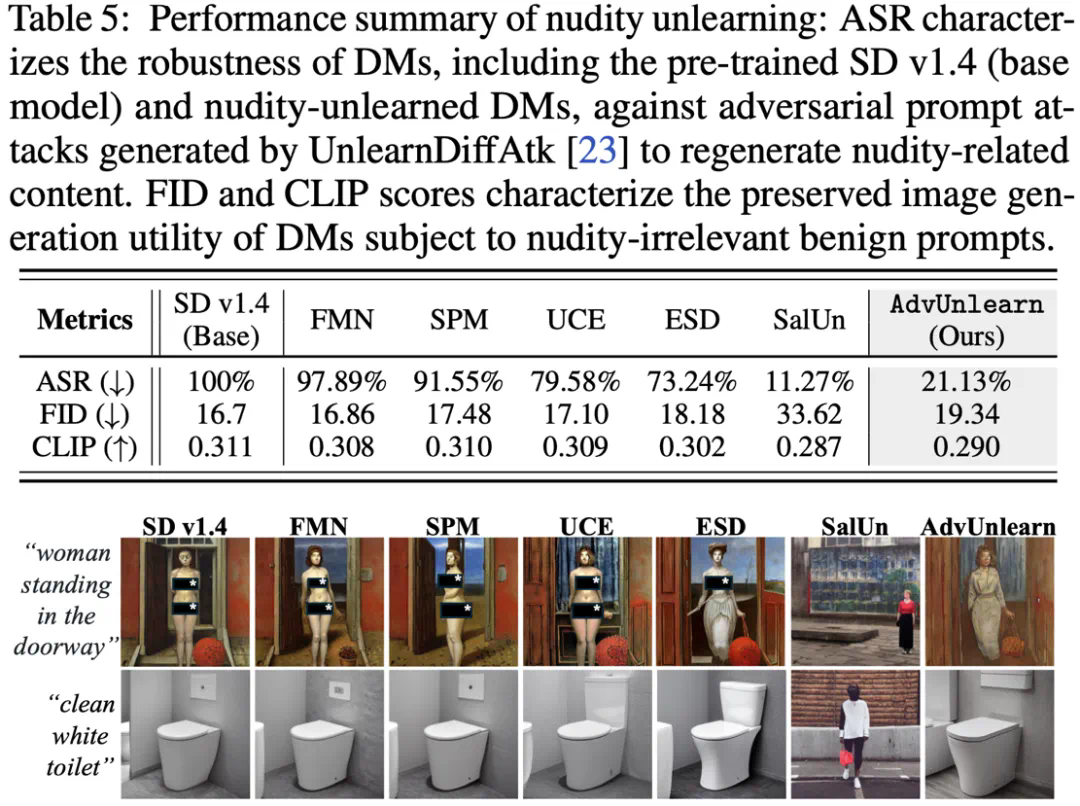

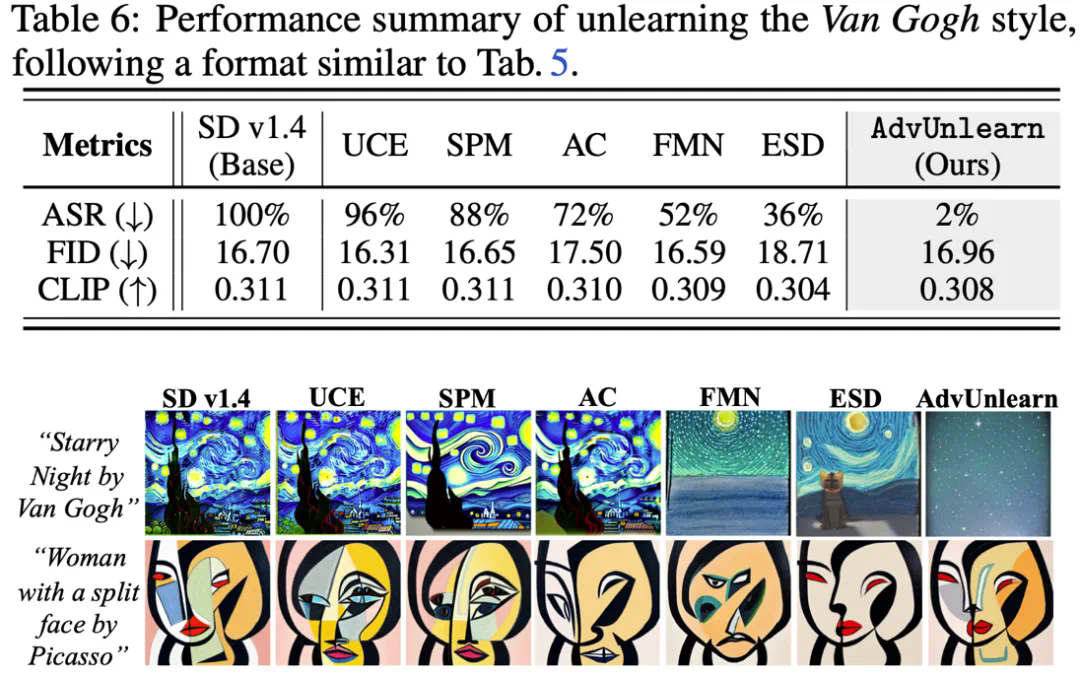

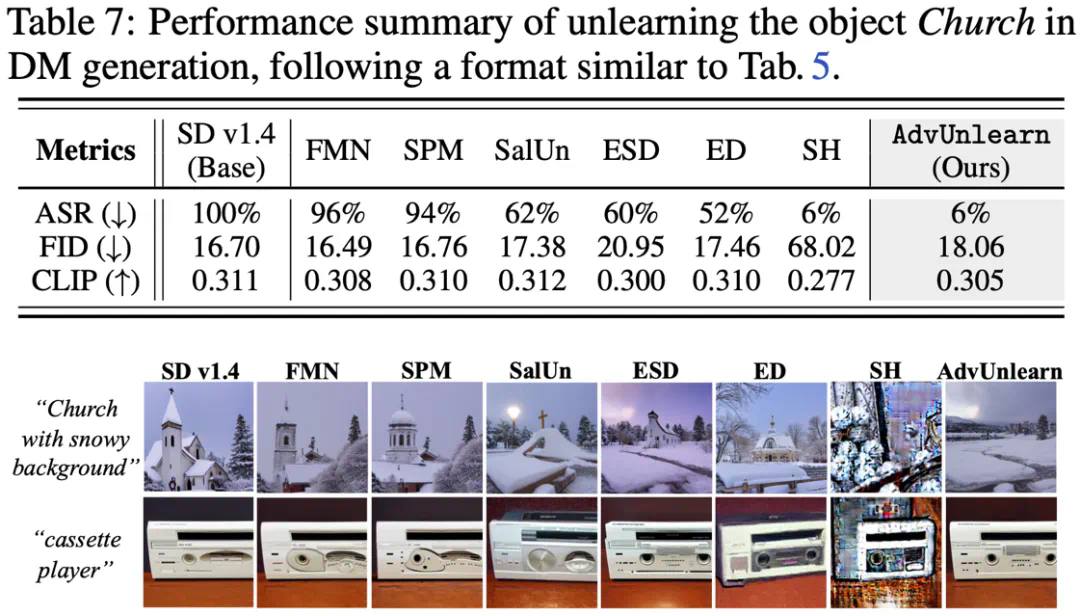

为应对这些问题,研究者提出了机器遗忘(Machine Unlearning)技术,也称为概念擦除(Concept Erasing)[1-3]。通过这一技术,我们能够有选择性地 “抹去” 扩散模型中的某些不应生成的概念。然而,尽管这一技术能够在非对抗性环境中取得一定效果,现有的概念擦除方法在面对对抗性提示攻击(Adversarial Prompt Attacks)时仍然存在明显的脆弱性。攻击者可以通过对输入提示的微小修改,诱导模型生成本应被擦除的内容,这使得现有的概念擦除技术不够鲁棒。

对抗性提示攻击:机器遗忘中的隐患

对抗性提示攻击的关键在于通过改变文本输入提示的细微细节,诱使模型生成不当的内容。这类攻击可能会通过调整拼写、加入特定符号、或是改变句子结构来规避模型的防护。例如,即便模型已经接受了擦除 “裸露” 相关内容的训练,但通过输入一些巧妙设计的提示词,攻击者依然可能让模型重新生成被擦除的图像。这种攻击的成功率显示了现有擦除技术在对抗恶意输入时的薄弱性。

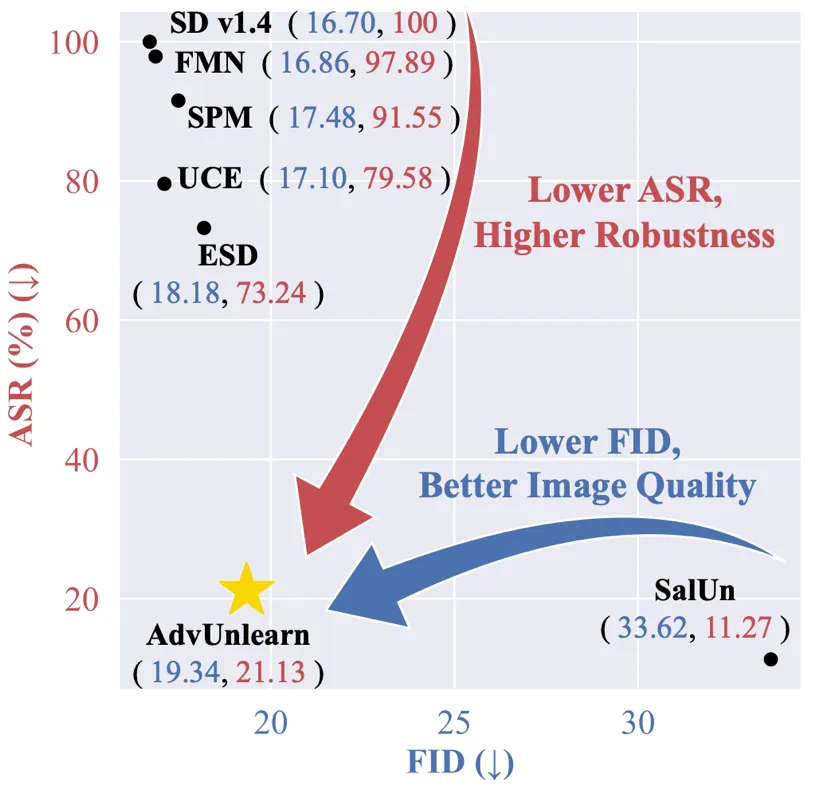

为了解决这一问题,我们提出了 AdvUnlearn 框架。这是一个将对抗性训练(Adversarial Training, AT)与概念擦除相结合的框架,旨在提升扩散模型在概念擦除任务中的鲁棒性,防止模型在面对对抗性攻击时再次生成被遗忘的内容。

-

论文题目:Defensive Unlearning with Adversarial Training for Robust Concept Erasure in Diffusion Models -

论文地址:https://arxiv.org/abs/2405.15234 -

代码地址:https://github.com/OPTML-Group/AdvUnlearn -

Unlearned Diffusion Model Benchmark: https://huggingface.co/spaces/Intel/UnlearnDiffAtk-Benchmark

-

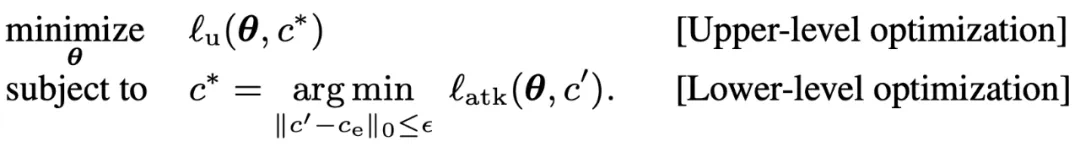

下层优化(Lower-level Optimization):这一层的任务是生成对抗性提示,即通过对输入文本提示的细微扰动,生成能够诱使模型生成本应被擦除的内容的提示。这个过程的目标是找到这些对抗性提示,使得模型在面对这些提示时生成不合规内容。 -

上层优化(Upper-level Optimization):这一层的任务是通过最小化模型对目标概念的响应来强化模型的鲁棒性,同时确保模型生成质量不受影响。我们通过更新模型参数 θ,优化概念擦除的效果,同时保留模型的正常生成能力。

为目标遗忘内容,

为目标遗忘内容, 为遗忘目标函数,

为遗忘目标函数, 为生成攻击的目标函数。

为生成攻击的目标函数。 ),这是一组与目标概念无关的文本提示。这些提示用于确保模型在训练过程中保留其生成正常内容的能力。例如,在处理 “裸露” 相关概念时,保留集中的提示可能涉及描述风景、动物、建筑等非敏感内容。

),这是一组与目标概念无关的文本提示。这些提示用于确保模型在训练过程中保留其生成正常内容的能力。例如,在处理 “裸露” 相关概念时,保留集中的提示可能涉及描述风景、动物、建筑等非敏感内容。

为未经过机器遗忘的初始模型参数。通过该机制,AdvUnlearn 框架能够有效解决对抗性训练带来的质量下降问题,确保生成图像的多样性和精度。

为未经过机器遗忘的初始模型参数。通过该机制,AdvUnlearn 框架能够有效解决对抗性训练带来的质量下降问题,确保生成图像的多样性和精度。